bōllettino #3 / Confidarsi con un'AI?

Intelligenze artificiali che si mangiano software e il lancio della nuova azienda del numero 2 di OpenAI.

Benvenuti su ōmega, un progetto editoriale a cura di Roberto Pizzato e Cesare Alemanni. Scriviamo di intelligenza artificiale e dei suoi riflessi sulla società.

Vi ricordiamo che ōmega è anche un podcast, una pagina Instagram e che ci potete scrivere all’indirizzo rivista.omega@gmail.com.

Questo è il terzo numero di bōllettino, rubrica a-periodica di ōmega in cui commentiamo alcune delle notizie più interessanti del panorama AI e dintorni di questo periodo. Cominciamo.

Future You e l’intimità artificiale

Future you è un piccolo progetto/esperimento di MIT che mira a permettere alle persone di chiacchierare con una futura versione di se stessi, realizzata a partire da un large language model basato su dati e interviste condotte coi soggetti che si sono sottoposti all’esperimento. Come si legge in un comunicato sul progetto, l’idea di Future you è ispirata da:

“studi che mostrano come una maggiore ‘continuità futura del sé’ (il grado di continuità che un individuo sente con il proprio sé futuro) può influenzare positivamente l’attitudine al risparmio, il rendimento scolastico, la salute mentale e la qualità soggettiva della vita, la nostra chat interattiva basata sul web la piattaforma cerca di aiutare in modo simile gli utenti a sviluppare pensieri e comportamenti più a lungo termine rafforzando la loro relazione con una versione riconoscibile ma virtuale del loro sé futuro”

Benché il progetto sia sperimentale e gli intenti positivi, Future you rappresenta la crescente tendenza a confondere tra relazione funzionale e relazione personale con le AI. Una confusione che comporta i suoi rischi, come hanno sottolineato già diversi studi in proposito al problema della cosiddetta “AI intimacy”.

Trattare l’AI come un’arma nucleare

In una recente conversazione con ChinaTalk, uno dei nostri podcast preferiti, l’esperto di cybersicurezza e consigliere dell’Homeland Security Dimitri Alperovitch si è espresso in questi termini a proposito dell’industria dell’AI e del modo in cui essa dovrebbe essere considerata.

Jordan Schneider (il conduttore di China Talk, ndR): È ragionevole aspettarsi che il modello di GPT-6 sia sicuro (nel senso di: non sia a rischio di essere trafugato, ndR)?

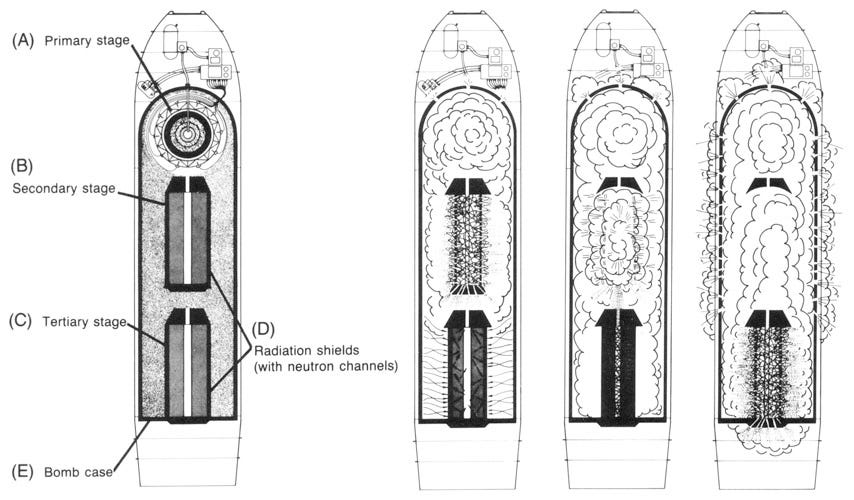

Dmitri Alperovitch: Sarà davvero, davvero difficile. E' un codice. È un file. […] Se crediamo l’intelligenza artificiale rivoluzionaria, dovremmo trattarla nello stesso modo in cui trattiamo i progetti delle armi nucleari. Chiunque ci abbia a che fare dovrebbe essere sottoposto al poligrafo, dovremmo proteggere i data center con le armi e certamente applicare tutte le nostre risorse federali al controllo dei dipendenti di queste aziende. Non stiamo facendo nulla di tutto ciò.

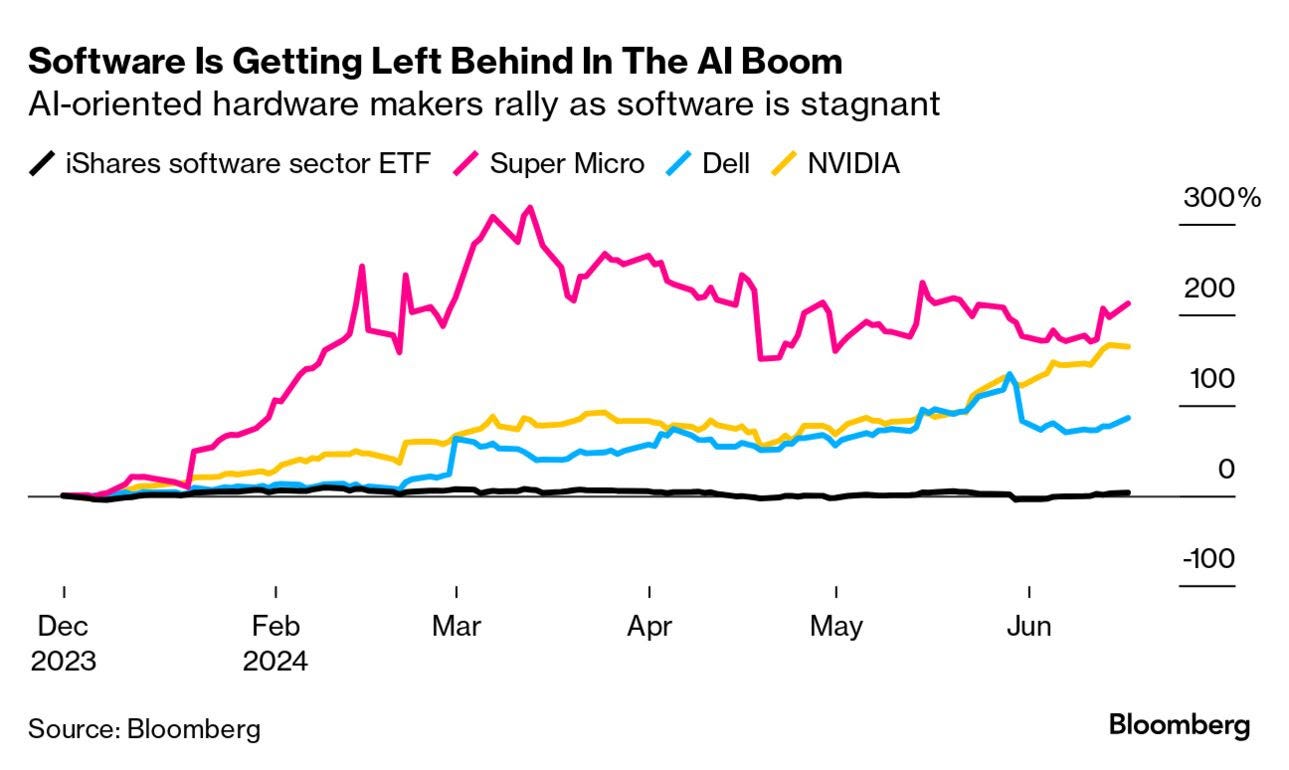

L’AI si sta davvero mangiando il software?

Negli anni Zero andava di moda dire che il software si stava “mangiando il mondo”. Poi, più di recente, nel 2017, il CEO di Nvidia Jensen Huang ha dichiarato che “l’AI si sarebbe mangiata il mondo”. Da allora la frase è diventata molto hype. Ora che siamo nel pieno di un boom dell’AI è lecito chiedersi: è davvero così che sta andando?

Di recente la domanda se l’è posta Saritha Rai, un reporter di Bloomberg specializzato in un’AI, che ha condensato la risposta in una newsletter, che comincia così e ci ricorda che non sempre ciò che è tecnologicamente possibile è anche economicamente razionale:

Ogni giorno nella mia casella di posta elettronica ricevo un altro comunicato stampa di un'azienda tecnologica che lancia una funzionalità di intelligenza artificiale generativa.

È chiaro che i produttori di applicazioni sono concentrati sulla creazione di strumenti di intelligenza artificiale. Ciò che è meno chiaro è se qualcuno sia disposto a pagare per averli.

Le nuove funzionalità generative ti consentono di creare presentazioni utilizzando Salesforce, riepilogare le competenze dei tuoi dipendenti in Workday, creare immagini dalle richieste in Photoshop di Adobe Inc. e redigere automaticamente risposte alle richieste IT in ServiceNow.

Ma a un anno e mezzo di mania per l’intelligenza artificiale, non ci sono molte entrate da mostrare per questo lavoro. Per la maggior parte delle grandi aziende di software applicativo, le vendite legate all’intelligenza artificiale non appariranno nei conti profitti e perdite fino al prossimo anno – o l’anno successivo.

In molti casi, le società di software non possono nemmeno decidere come addebitarli. Alcuni utilizzano l'intelligenza artificiale come strumento per livelli di abbonamento più costosi, altri vendono "crediti generativi" e alcuni altri, come Zoom Video Communications Inc., si limitano a raggruppare gratuitamente funzionalità di intelligenza artificiale.

SUPERINTELLIGENZA!

Questo tweet è senza dubbio l’annuncio della settimana nel campo dell’AI.

Non fosse altro perché Ilya è l’ex Chief Scientist di OpenAI e in generale è considerato uno dei più dotati ingegneri nel campo dell’AI. Nel novembre 2023 Sutskever era stato tra i membri del board di OpenAI che avevano sfiduciato Sam Altman e, in seguito al ritorno di quest’ultimo, aveva rassegnato le dimissioni dalla società di ChatGPT.

Due giorni fa Sutskever ha annunciato la propria nuova azienda SSI.inc – un acronimo che sta per Safe SuperIntelligence – e il cui obiettivo, lo dice il nome, è di costruire una “superintelligenza” artificiale. Come si legge nel tweet dell’annuncio:

La superintelligenza è a portata di mano.

Costruire una superintelligenza sicura (SSI) è il problema tecnico più importante del nostro tempo.

Abbiamo avviato il primo laboratorio SSI diretto al mondo, con un obiettivo e un prodotto: una superintelligenza sicura.

Si chiama Safe Superintelligence Inc.

SSI è la nostra missione, il nostro nome e l'intera tabella di marcia dei nostri prodotti, perché è il nostro unico obiettivo. Il nostro team, gli investitori e il modello di business sono tutti allineati per raggiungere l’SSI.

Affrontiamo la sicurezza e le capacità in tandem, come problemi tecnici da risolvere attraverso innovazioni ingegneristiche e scientifiche rivoluzionarie. Abbiamo intenzione di far avanzare le nostre capacità il più velocemente possibile, assicurandoci al tempo stesso che la nostra sicurezza rimanga sempre al passo con i tempi.

In questo modo possiamo crescere in tutta tranquillità.

Il nostro focus unico non implica alcuna distrazione da parte delle spese generali di gestione o dei cicli di prodotto, e il nostro modello di business significa che la sicurezza, la protezione e il progresso sono tutti isolati dalle pressioni commerciali a breve termine.

Siamo un'azienda americana con sedi a Palo Alto e Tel Aviv, dove abbiamo radici profonde e la capacità di reclutare i migliori talenti tecnici.

Stiamo mettendo insieme un team snello e competente composto dai migliori ingegneri e ricercatori del mondo, dedicato a concentrarsi sull’SSI e nient’altro.

Se sei tu, ti offriamo l’opportunità di svolgere il lavoro della tua vita e di aiutarti a risolvere la sfida tecnica più importante della nostra epoca.

Ora è il momento. Unisciti a noi.

E con questo è tutto per questa terza edizione del nostro bōllettino sull’AI.

Vi salutiamo e vi ricordiamo che se ancora non lo avete fatto potete iscrivervi usando questo box.

O consigliare ōmega ad amici, condividendolo con questo pulsante.

Alla prossima!